오늘 공부한 내용은 Ch.7-8입니다.

– RNN 및 벡터화 공식

– RNN 배경 및 구조적 한계

퍼셉트론 -> MLP -> CNN -> RNN. 한 달이 지났지만 많이 배웠죠? 오늘은 마지막 장인 순환 신경망에 대해 공부해 봅시다. 아직 갈 길이 멀지만 이렇게 기본을 공부하다 보니 논문을 읽고 실천할 수 있는 능력이 생깁니다.

1. 순환 신경망이란 무엇입니까?

RNN은 입력을 순차적으로 공급하는 모델입니다. 따라서 RNN은 광범위한 응용 프로그램을 가지고 있습니다. 예를 들어, 언어로 된 문장을 볼 때 글자의 순서가 중요합니까? 레코드는 순차적 데이터, 즉 이 RNN에 해당하는 데이터입니다. 영상이 그렇네요. 비디오는 일련의 이미지입니다. 그리고 주식도 순차적인 데이터이기 때문에 미래의 주가를 예측하는 애플리케이션을 RNN 모델로 사용할 수 있습니다.

여기서 recurring이라는 단어는 “다시 또는 반복적으로 발생”을 의미합니다. 첫 번째 입력이 오면 MLP를 실행하여 결과 h1(가중치)을 가중치로 계산하고, 두 번째 입력이 오면 새로운 가중치 h2를 얻고, 세 번째 입력이 오면 다시 h2와 동일하게 계산하여 새로운 h3을 얻는다. 무게. 이 경우 5번째 입력에 대한 가중치는 x_i와 W_i 각각 1, 2, 3, 4를 고려한 h_i 값이며 이 h_i는 이전 정보를 담는 데 사용됩니다.

2. RNN 역전파와 구조적 한계

“HELL_”, 다음 공백에 들어갈 알파벳은? 26개의 알파벳 중 하나이니 실제로 우리가 배운 “다계급 문제다!”라고 부를 수 있습니다. x1, x2, x3, x4 = {H, E, L, L}을 입력하고 y2, y3, y4, y5는 다음 문자 {E, L, L, O}입니다. 이런 식으로 다음 날짜를 순차 데이터에 통합하면 구글 검색창에서 검색할 때 자동 추천 검색 결과 등의 애플리케이션을 실행할 수 있다.

RNN 역전파는 이전에 들었던 MLP와 유사합니다. 손실을 계산할 때 교차 엔트로피는 역미분하면서 활성화와 가중치를 계산합니다. 이 프로세스에서 h4 -> h3 -> h2 -> h1 이전의 모든 활성화 및 가중치를 계산합니다. 따라서 다재다능함은 좋지만 콘텐츠가 오래될수록 흐릿해집니다. 구조적으로 ADAM과 유사합니다.

이러한 특성으로 인해 RNN은 몇 가지 만성적인 문제를 겪고 있습니다.

1. 가면 갈수록 잊는다(5배의 손실을 계산하면 1배의 손실은 0에 가까워진다)

2. 점진적 블러링(tanh를 사용할 때 그래디언트 소멸에 약할 수 있음)

다음 세션에서 우리는 이러한 문제를 완화하고 연습할 것입니다. 노력해 주셔서 대단히 감사합니다!

2 테스트 녹음: 강의 노트 만들기

이 게시물은 Fast Campus Fire Level Challenge에 참여하기 위해 작성되었습니다. 꼼꼼히 읽어주셔서 감사합니다!

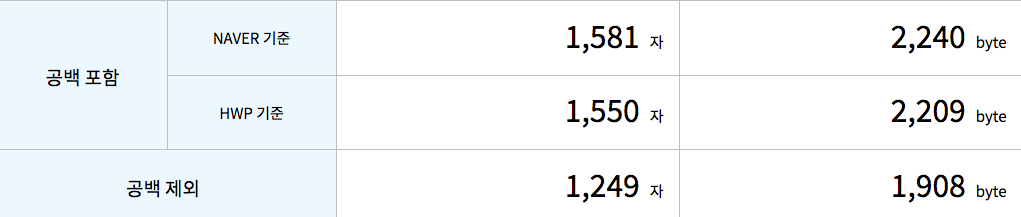

공백 없음: 1249자

패스트 캠퍼스: http://bit.ly/3Y34pE0

Fast Campus(직원 교육)

프로그래밍, 비디오 편집, UX/UI, 마케팅, 데이터 분석, Excel 강의, The RED, 정부 자금 지원, 기업 교육 및 서비스 제공.

fastcampus.co.kr